从0了解深度学习——相关知识

本系列文章 从0了解深度学习 以书籍 邱锡鹏.《神经网络与深度学习》(蒲公英书)为参考

该系列文章在前系列文章 从0了解机器学习 (以下简称机器学习)的基础上进行讲解,对于重复的内容,我们作省略,如有需要请查看机器学习相关文章

(如果文章中的公式不能正常显示,请刷新该页面。如果还不能解决,请邮箱联系我,谢谢...)

该书籍对于零基础十分友好,全书讲的通俗易懂,我也推荐大家将其作为新手入门书籍去学习

本文章提要

由于书籍前三章讲的是关于一些机器学习的内容,这里作部分省略,将一些机器学习没有提到的内容进行说明

可能内容比较零散

神经网络和深度学习的关系

神经网络:一种以神经元为基本单位的模型

深度学习:一种机器学习问题,主要解决 贡献度分配问题

二者为不同的东西,神经网络可以看作深度学习中的主要模型,但在当前环境下:

神经网络 ≈ 深度学习

或者说以神经网络为主要模型的深度学习

神经网络

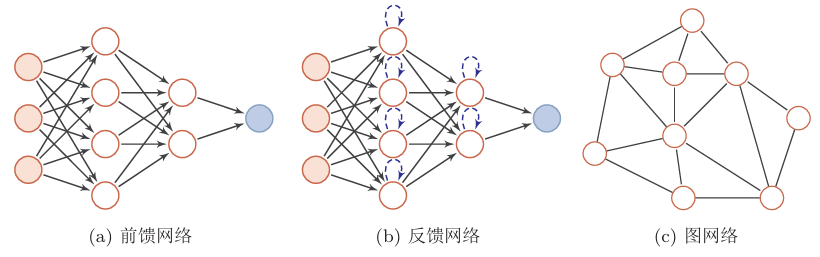

主要由大量神经元及他们之间的有向连接构成,主要为三方面:

- 神经元的激活规则:神经元输入到输出之间的映射关系,一般为非线性函数

- 网络的拓扑结构:不同神经元之间的连接关系

- 学习算法:通过训练数据来学习神经网络的参数

人工神经网络由神经元模型构成,这种信息处理网络具有并行分布结构

虽然网络大体上分为三种类型,但大多数网络都是复合结构,即一个网络包含多种网络类型

表示

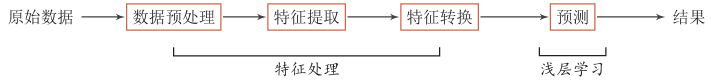

当我们用机器学习来解决一些模式识别任务时,流程如下:

浅层学习:不涉及特征学习,其特征主要靠人工经验或者特征转换方法来抽取

语义鸿沟:人工智能挑战之一(底层特征 VS 高层语义)

人们对文本、图像的理解无法从字符串或者图像底层特征直接获取

什么是好的数据表示:主观概念,没有标准

但好的表示有以下优点:

- 具有很强的表示能力

- 使后续的学习任务变得简单

- 具有一般性,是任务或邻域独立的

表示形式:

- 局部表示

- 离散表示,符号表示

- One-hot向量

- 分布式表示

- 压缩、低维、稠密向量

- 用O(n)个参数表示O(2^k)个区间(k≠0,k<n)

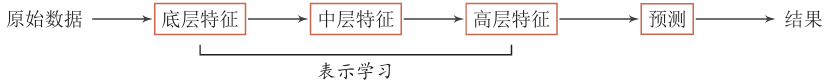

表示学习

如何自动从数据中学习好的表示

通过构建具有一定“深度”的模型,可以让模型来自动学习好的特征表示,从而最终提升预测或识别的准确性

从人工进行特征提取——>机器自动学习

特征提取:基于任务或先验来去除无用特征(不一定对模型有帮助)

表示学习:通过深度模型学习高层语义特征,从输入到输出串联起来(学习到的表示对后面的学习有帮助)

难点:没有明确的目标,所有信息都间接来自后面分类器的效果,和整个模型预测结果一起学习

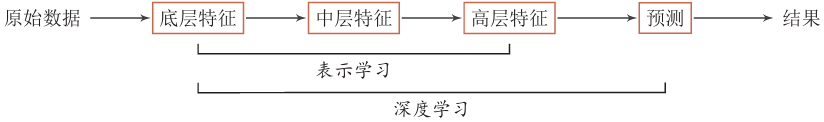

表示学习与深度学习

一个好的表示学习策略必须具有一定深度

- 特征重用:指数级的表示能力

- 抽象表示与不变性:抽象表示需要多步构建

深度学习 = 表示学习 + 决策(预测/浅层)学习

贡献度分配问题

结果的产生具体与哪层的特征学习引起/关联最大

一个很好的解决模型:神经网络

偏导数:

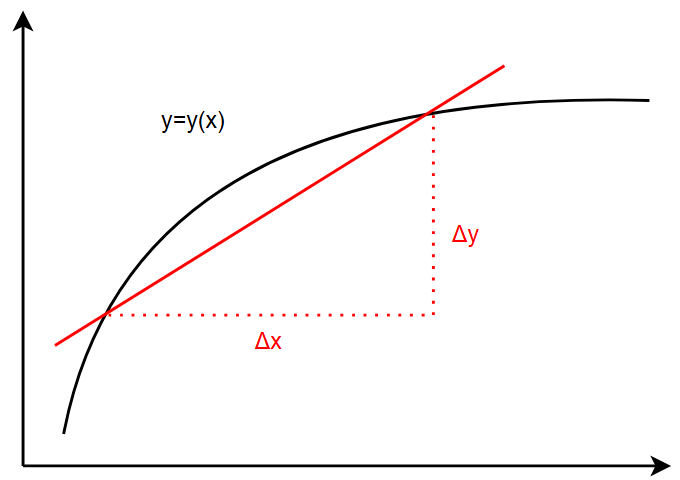

\(斜率=\frac{\Delta{y}}{\Delta{x}}\) :斜率越大,则 x 对 y 的贡献越大

贡献度: \[ \frac{\partial{y}}{\partial{w}}=\frac{y(w+\Delta{w})-y(w)}{\Delta{w}} \] 对 \(\Delta{w}\) 进行扰动,若结果变化越大,则其贡献度越大

一些机器学习顶会期刊

机器学习与传统人工智能

- NeurIPS

- ICLR

- ICML

- AAAI

- IJCAI

自然语言处理

- ACL

- EMNLP

计算机视觉

- CVPR

- ICCV

神经网络发展史

第一阶段:模型提出

第一个阶段为1943~1969年,是神经网络发展的第一个高潮期。在此期间,科学家们提出了许多神经元模型和学习规则

在1943年,心理学家WarrenMcCulloch和数学家Walter Pitts最早描述了 一种理想化的人工神经网络,并构建了一种基于简单逻辑运算的计算机制。他们提出的神经网络模型称为MP模型。至此,开启了神经网络研究的序幕

阿兰·图灵在1948年的论文中描述了一种“B型图灵机”。之后,研究人员将基于赫布型学习的思想应用到“B型图灵机”上

1951年,McCulloch和Pitts的学生Marvin Minsky建造了第一台神经网络机SNARC

Rosenblatt [1958]最早提出可以模拟人类感知能力的神经网络模型,并称 之为感知器(Perceptron),并提出了一种接近于人类学习过程(迭代、试错) 的学习算法。但感知器因其结构过于简单,不能解决简单的异或(XOR)等线性不可分问题

在这一时期,神经网络以其独特的结构和处理信息的方法,在许多实际应 用领域(自动控制领域、模式识别等)中取得了显著的成效

第二阶段:冰河期

第二阶段为1969年~1983年,为神经网络发展的第一个低谷期。在此期间,神经网络的研究处于长年停滞及低潮状态

1969年,Marvin Minsky出版《感知机》一书,指出了神经网络的两个关键缺陷:第一个是感知机无法处理异或回路问题;第二个是当时的计算机无法支持处理大型神经网络所需要计算能力。这些论断直接将以感知器为代表的神经网络打入冷宫,导致神经网络的研究进入了十多年的“冰河期”

1974 年,哈佛大学的Paul Webos发明反向传播算法(Backpropagation, BP),但当时未受到应有的重视

1980年,Fukushima [1980](福岛邦彦)提出了一种带卷积和子采样操作的多层神经网络:新知机(Neocognitron)。新知机的提出是受到了动物初级视皮层简单细胞和复杂细胞的感受野的启发。但新知机并没有采用反向传播算法, 而是采用了无监督学习的方式来训练,因此没有引起足够的重视

第三阶段:反向传播算法引起的复兴

第三阶段为1983年~1995年,为神经网络发展的第二个高潮期。这个时期中,反向传播算法重新激发了人们对神经网络的兴趣

1983年,加州理工学院的物理学家JohnHopfield提出了一种用于联想记忆和优化计算的神经网络,称为Hopfield网络。Hopfield网络在旅行商问题上获得当时最好结果,并引起了轰动

1984年,Geoffrey Hinton提出一种随机化版本的Hopfield网络,即玻尔兹曼机

真正引起神经网络第二次研究高潮的是反向传播算法。1986年,DavidRumel hart和James McClelland对于连接主义在计算机模拟神经活动中的应用提供了全面的论述,并重新发明了反向传播算法。GeoffreyHinton等人将引入到多层感知器[Williams and Hinton, 1986],人工神经网络才又重新引起人们的注意, 并开始成为新的研究热点。随后,LeCunetal. [1989]将反向传播算法引入了卷积神经网络,并在手写体数字识别上取得了很大的成功[LeCunetal.,1998]。反向传播算法是迄今最为成功的神经网络学习算法,不仅用于多层前馈神经网络, 还用于其他类型神经网络的训练

第四阶段:流行度降低

第四个阶段为1995~2006年,在此期间,支持向量机和其他更简单的方法(例如线性分类器)在机器学习领域的流行度逐渐超过了神经网络

虽然神经网络可以很容易地增加层数、神经元数量,而从构建复杂的网络, 但其计算复杂性也会指数级增长。当时的计算机性能和数据规模不足以支持训练大规模的神经网络。在20世纪90年代中期,统计学习理论和以支持向量机为代表的机器学习模型开始兴起。相比之下,神经网络的理论基础不清晰、优化困难、可解释性差等缺点更加凸显,神经网络的研究又一次陷入低潮

第五阶段:深度学习的崛起

2006年,Hinton and Salakhutdinov [2006]发现多层前馈神经网络可以先通过逐层预训练,再用反向传播算法进行精调的方式进行有效学习。随着深度的人工神经网络在语音识别[Hintonet al., 2012]和图像分类[Krizhevsky et al., 2012]等任务上的巨大成功,以神经网络为基础的“深度学习”迅速崛起。近年来,随着大规模并行计算以及GPU设备的普及,计算机的计算能力得以大幅提高。此外,可供机器学习的数据规模也越来越大。在计算能力和数据规模的支持下,计算机已经可以训练大规模的人工神经网络。各大科技公司都投入巨资研究深度学习,神经网络迎来第三次高潮

结语

本文章是该系列的第一篇文章,负责将 邱锡鹏.《神经网络与深度学习》(蒲公英书)书中前三章的一些零散知识进行说明,因为前三章大部分知识在机器学习文章中已经讲过,所以不可能原封不动再讲一遍

之后将陆续更新剩下几章的内容,敬请期待...

从0了解深度学习——相关知识